urllib

學習python完基礎,有些迷茫.眼睛一閉,一種空白的窒息源源不斷而來.還是缺少練習,遂拿爬蟲來練練手.學習完斯巴達python爬蟲課程后,將心得整理如下,供后續翻看.整篇筆記主要分以下幾個部分:

- 1.做一個簡單的爬蟲程序

- 2.小試牛刀--抓取百度貼吧圖片

- 3.總結

1.做一個簡單的爬蟲程序

首先環境描述

- Device: Mba 2012 Yosemite 10.10.1

- Python: python 2.7.9

- 編輯器: Sublime Text 3

這個沒有什么好說的,直接上代碼吧!

'''@ urllib為python自帶的一個網絡庫@ urlopen為urllib的一個方法,用于打開一個連接并抓取網頁, 然后通過read()方法把值賦給read()'''import urlliburl = "http://www.lifevc.com"#多嘴兩句,為什么要選lifevc呢,主要是最近它很惹我.html = urllib.urlopen(url)content = html.read()html.close()#可以通過print打印出網頁內容print content

很簡單,基本上沒有可說的,這個也就是python的魅力,幾行代碼就完成.

當然我們僅僅抓取網頁,沒有實在的價值.接下來我們就開始做一點有意義的事情.

2.小試牛刀

抓取百度貼吧圖片

其實也很簡單,因為要抓取圖片,還需要先分析一下網頁源代碼

(這里以知道基本html知識,瀏覽器以chrome為例)

如圖,這里簡要說下步驟,請參考.

打開網頁,右鍵點擊,選擇"inspect Element"(最下面這一項)

點擊下面彈起來的框框最左邊那個問號,問號會變成藍色

移動鼠標去點擊我們想要抓取的圖片(一個萌妹子)

如圖,我們就可以圖片在源碼中的位置了

下面將源碼相關拷貝出來

<img class="BDE_Image" src="http://imgsrc.baidu.com/forum/w%3D580/sign=3d5aacaab21c8701d6b6b2ee177e9e6e/17a6d439b6003af329aece2e342ac65c1138b6d8.jpg" height="840" width="560" style="cursor: url(http://tb2.bdstatic.com/tb/static-pb/img/cur_zin.cur), pointer;">

經分析和對比(這里略掉),基本上可以看到要抓取的圖片幾個特征:

- 在img標簽下

- 在名為BDE_Image的類下面

- 圖片格式為jpg

正則表達式后續我會更新,請關注

依照上述判斷,直接上代碼

'''@本程序用來下載百度貼吧圖片@re 為正則說明庫'''import urllibimport re# 獲取網頁html信息url = "http://tieba.baidu.com/p/2336739808"html = urllib.urlopen(url)content = html.read()html.close()# 通過正則匹配圖片特征,并獲取圖片鏈接img_tag = re.compile(r'class="BDE_Image" src="(.+?/.jpg)"')img_links = re.findall(img_tag, content)# 下載圖片 img_counter為圖片計數器(文件名)img_counter = 0for img_link in img_links: img_name = '%s.jpg' % img_counter urllib.urlretrieve(img_link, "//Users//Sean//Downloads//tieba//%s" %img_name) img_counter += 1

如圖,我們就抓取你懂的圖片

3.總結

如上兩節,我們就很輕松的就可以網頁或者圖片.

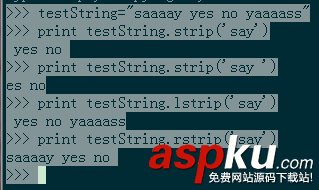

補充一點小技巧,如果遇到不是很明白的庫或者方法,可以通過以下方法進行初步了解.

- dir(urllib) #查看當前庫有哪些方法

- help(urllib.urlretrieve) #查看跟當前方法相關的作用或者參數,官方比較權威

或者https://docs.python.org/2/library/index.html進項相關搜索.

當然百度也可以,但是效率太低.建議使用 http://xie.lu 進行相關搜索(你懂了,絕對滿意).

這里我們講解如何抓取網頁和下載圖片,在下面我們會講解如何抓取有限制抓取的網站.

urllib2

上面我們講解如何抓取網頁和下載圖片,在下一節里面我們會講解如何抓取有限制抓取的網站

首先,我們依然用我們上一節課的方法去抓取一個大家都用來舉例的網站<blog.cndn.net>,本文主要分以下幾個部分:

- 1.抓取受限網頁

- 2.對代碼進行一些優化

1.抓取受限網頁

首先使用我們上一節學到的知識測試一下:

'''@本程序用來抓取blog.csdn.net網頁'''import urlliburl = "http://blog.csdn.net/FansUnion"html = urllib.urlopen(url)#getcode()方法為返回Http狀態碼print html.getcode()html.close()#輸出

403

此處我們的輸出為403,代表拒絕訪問;同理200表示請求成功完成;404表示網址未找到.

可見csdn已做了相關屏蔽,通過第一節的方法是無法獲取網頁,在這里我們需要啟動一個新的庫:urllib2

但是我們也看到瀏覽器可以發那個文,是不是我們模擬瀏覽器操作,就可以獲取網頁信息.

老辦法,我們先來看看瀏覽器是如何提交請求給csdn服務器的.首先簡述一下方法:

- 打開網頁,右鍵點擊,選擇"inspect Element"(最下面這一項)

- 點擊下面彈起來的框框的Network選項卡

- 刷新網頁,就可以看到Network選項卡抓取了很多信息

- 找到其中一個信息展開,就能看到請求包的Header

以下就是整理后的Header信息

Request Method:GETHost:blog.csdn.netReferer:http://blog.csdn.net/?ref=toolbar_logoUser-Agent:Mozilla/5.0 (Macintosh; Intel Mac OS X 10_10_1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/38.0.2125.104 Safari/537.36

然后根據提取的Header信息,利用urllib2的Request方法模擬瀏覽器向服務器提交請求,代碼如下:

# coding=utf-8'''@本程序用來抓取受限網頁(blog.csdn.net)@User-Agent:客戶端瀏覽器版本@Host:服務器地址@Referer:跳轉地址@GET:請求方法為GET'''import urllib2url = "http://blog.csdn.net/FansUnion"#定制自定義Header,模擬瀏覽器向服務器提交請求req = urllib2.Request(url)req.add_header('User-Agent', 'Mozilla/5.0 (Windows NT 6.3; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/39.0.2171.95 Safari/537.36')req.add_header('Host', 'blog.csdn.net')req.add_header('Referer', 'http://blog.csdn.net')req.add_header('GET', url)#下載網頁html并打印html = urllib2.urlopen(req)content = html.read()print contenthtml.close() 呵呵,你限制我,我就跳過你的限制.據說只要瀏覽器能夠訪問的,就能夠通過爬蟲抓取.

2.對代碼進行一些優化

簡化提交Header方法

發現每次寫那么多req.add_header對自己來說是一種折磨,有沒有什么方法可以只要復制過來就使用.答案是肯定的.

#input:help(urllib2.Request)#output(因篇幅關系,只取__init__方法)__init__(self, url, data=None, headers={}, origin_req_host=None, unverifiable=False)通過觀察,我們發現headers={},就是說可以以字典的方式提交header信息.那就動手試試咯!!#只取自定義Header部分代碼csdn_headers = { "User-Agent": "Mozilla/5.0 (Windows NT 6.3; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/39.0.2171.95 Safari/537.36", "Host": "blog.csdn.net", 'Referer': 'http://blog.csdn.net', "GET": url }req = urllib2.Request(url,headers=csdn_headers) 發現是不是很簡單,在這里感謝斯巴達的無私賜教.

提供動態頭部信息

如果按照上述方法進行抓取,很多時候會因為提交信息過于單一,被服務器認為是機器爬蟲進行拒絕.

那我們是不是有一些更為智能的方法提交一些動態的數據,答案肯定也是肯定的.而且很簡單,直接上代碼!

'''@本程序是用來動態提交Header信息@random 動態庫,詳情請參考<https://docs.python.org/2/library/random.html>'''# coding=utf-8import urllib2import randomurl = 'http://www.lifevc.com/'my_headers = [ 'Mozilla/4.0 (compatible; MSIE 8.0; Windows NT 5.1; Trident/4.0; .NET CLR 2.0.50727; .NET CLR 3.0.04506.30; .NET CLR 3.0.04506.648)', 'Mozilla/4.0 (compatible; MSIE 8.0; Windows NT 5.1; Trident/4.0; .NET CLR 2.0.50727; InfoPath.1', 'Mozilla/4.0 (compatible; GoogleToolbar 5.0.2124.2070; Windows 6.0; MSIE 8.0.6001.18241)', 'Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; WOW64; Trident/5.0)', 'Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; WOW64; Trident/5.0; Sleipnir/2.9.8)', #因篇幅關系,此處省略N條]random_header = random.choice(headers)# 可以通過print random_header查看提交的header信息req = urllib2.Request(url)req.add_header("User-Agent", random_header)req.add_header('Host', 'blog.csdn.net')req.add_header('Referer', 'http://blog.csdn.net')req.add_header('GET', url)content = urllib2.urlopen(req).read()print content 其實很簡單,這樣我們就完成了對代碼的一些優化.